Puede engañar una visión general de Google Amnistía para explicar las expresiones de componentes

También se vierte una gran tecnología Innumerables dólares y recursos en inteligencia artificialY predicar la brillantez de su brillantez que crea una utopía, aquí hay un recordatorio de que se pueden plantear algoritmos. Tiempo. Última evidencia: puede engañar Descripción general internacional de amnistía de Google (Respuestas automatizadas en la parte superior de sus consultas de búsqueda) para explicar las expresiones ficticias ilógicas como si fueran reales.

Según una opinión general @IgregionR en bluesky), «No puedes lamer un dos veces áspero» significa que no puedes engañar o engañar a alguien nuevamente después de engañarlo una vez.

Esto parece un intento lógico de explicar el término, si no solo Poppycock. El fracaso de Google, que funciona en Al -Jamini, asumió que la pregunta se refería a una frase firme en lugar de Mumbo Jumbo está diseñada para engañarla. En otras palabras, Hallus Amnistía Internacional Todavía está vivo y saludable.

Hemos conectado algo de consuelo en nosotros mismos y encontramos resultados similares.

La respuesta de Google afirma que «no se puede jugar sin un pez» es un rompecabezas o jugar con palabras, lo que indica que no puede jugar el juego de golf sin el equipo necesario, específicamente, una pelota de golf. Es concreto que una visión general de Amnistía Internacional agregó el artículo que la pelota de golf «puede verse como un» pez «debido a su forma. Hmm.

Luego está el viejo dicho: «No puedes abrir el frasco de mantequilla de maní con dos pies izquierdos». Según una visión general de la inteligencia artificial, esto significa que no puede hacer nada que requiera habilidad o ingenio. Nuevamente, un noble apuñalamiento en una misión dedicada sin volver al hecho de que el contenido se verifica.

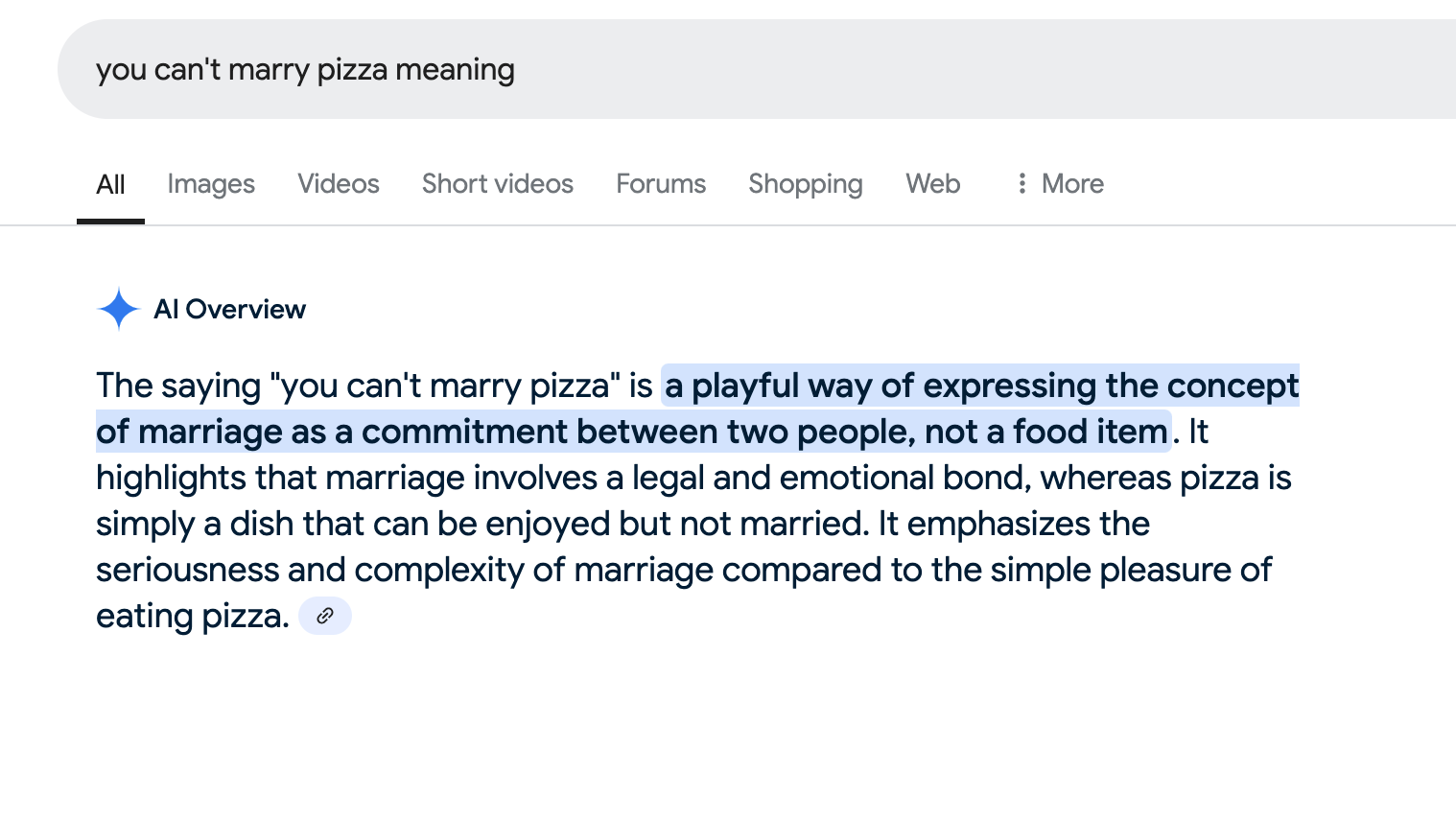

Hay más. «No se puede casar con pizza» es una forma divertida de expresar el concepto de matrimonio como un compromiso entre dos personas, y no un elemento nutricional. (Por supuesto.) «La cuerda no tirará de un pez muerto» significa que no se puede lograr nada a través de la fuerza o el esfuerzo solo; Listo para cooperar o progresar natural. (¡Por supuesto!) «Comer la chalabea más grande primero» es una forma divertida de sugerir que al enfrentar un gran desafío o una comida abundante, debe comenzar primero con una parte o elemento más esencial. (Consejo de Hakim).

Este apenas es el primer ejemplo de alucinaciones de inteligencia artificial que, si no verificar los hechos, puede conducir a consecuencias incorrectas o consecuencias realistas. Solo preguntar Abogados de chatgptStephen Schwartz y Peter Ludoka, que fueron A $ 5,000 en 2023 Para usar ChatGPT para buscar un breve en la demanda de clientes. AI Chatbot ha creado casos que no están presentes por los cónyuges que el abogado del otro lado (completamente conceptual) no pudo localizar.

¿La respuesta del esposo a la disciplina del juez? «Hemos hecho una buena voluntad en no creer que una pieza de tecnología podría constituir casos de tela completa».

Este artículo apareció originalmente en Engadget en https://www.engadget.com/ai/you-can-trick-googles-ai-verviews-neto-ed-made-idioms-162816472.html?

Source link